La seguridad digital atraviesa un cambio de paradigma debido al uso malintencionado de modelos avanzados de lenguaje. Google ha confirmado que los ciberdelincuentes ya no buscan únicamente tumbar sistemas, sino capturar la inteligencia que los hace funcionar. El riesgo ha pasado de ser una posibilidad teórica a convertirse en una amenaza real para la ciberseguridad.

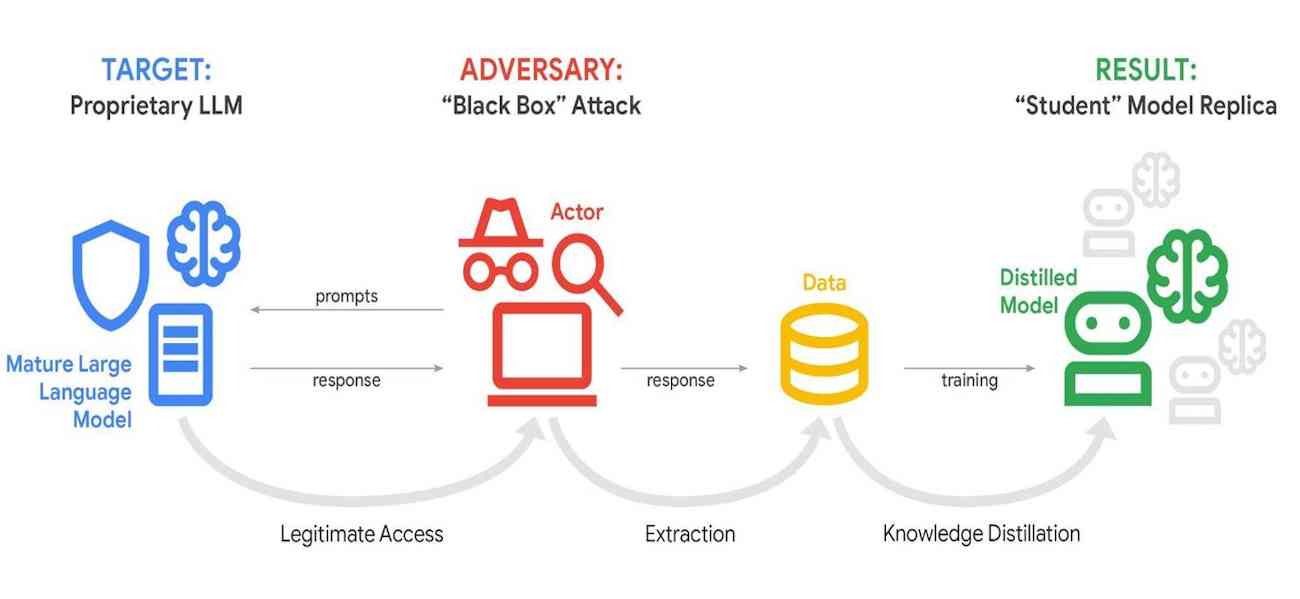

El informe anual de Google Threat Intelligence Group revela una tendencia preocupante denominada ataques de destilación. Esta técnica permite a los atacantes extraer conocimientos específicos y la lógica interna de herramientas como Gemini. El objetivo es clonar el razonamiento propietario para replicar capacidades avanzadas sin invertir en el desarrollo original.

Aumentan los ataques de destilación contra la IA de Google

Los investigadores han detectado que diversos actores, desde empresas privadas hasta académicos, intentan copiar los procesos de cadena de pensamiento. Estas tácticas se centran en obtener información sobre cómo razonan los modelos de inteligencia artificial generativa. No se trata de un simple hackeo, sino de un ciberespionaje dirigido a modelos de alto valor.

Un objetivo común para los atacantes es la capacidad de razonamiento de Gemini, la inteligencia artificial de Google.

Grupos de espionaje y el uso de Gemini

El grupo APT42, vinculado al gobierno iraní, destaca por ser uno de los más activos en el uso de estas tecnologías. Han utilizado la inteligencia artificial generativa para perfeccionar sus campañas de ingeniería social y reconocimiento. Al automatizar la búsqueda de correos oficiales, logran establecer pretextos mucho más creíbles para sus víctimas.

Por otro lado, el grupo UNC2970, relacionado con Corea del Norte, utiliza estas herramientas para sintetizar inteligencia de fuente abierta. Su estrategia consiste en hacerse pasar por reclutadores corporativos para atacar sectores estratégicos de defensa. La capacidad de perfilar objetivos de alto valor con IA ha facilitado enormemente sus campañas de ciberespionaje.

El malware con IA y la familia HONESTCUE

La evolución del software malicioso ha dado un salto cualitativo al integrar funciones dinámicas mediante código automatizado. La compañía Google ha identificado muestras de malware, denominadas HONESTCUE, que utilizan directamente la API de Gemini. Esta conexión permite al virus generar funcionalidades en tiempo real para evitar ser detectado por antivirus.

Esta técnica de subcontratación de funciones permite al malware eludir el análisis estático tradicional y la detección en red. Al no tener un comportamiento fijo, la amenaza se adapta según el entorno que infecta. La integración de la IA en el malware representa uno de los mayores desafíos tecnológicos para 2026.

Protección ante la nueva era del cibercrimen

Google Threat Intelligence Group ha implementado medidas para mitigar estos intentos de extracción de modelos en sus plataformas. Sin embargo, el informe advierte que el mal uso de la IA para tareas de codificación y scripts sigue creciendo. Los atacantes aprovechan estas herramientas para investigar vulnerabilidades públicas de forma mucho más veloz.

La vigilancia constante sobre el comportamiento de los modelos es ahora la prioridad absoluta para los equipos de seguridad. A medida que la IA se vuelve más accesible, la protección de su lógica interna es vital. La industria debe adaptarse rápido para evitar que el razonamiento subyacente de sus sistemas termine en manos equivocadas.

Comentarios!