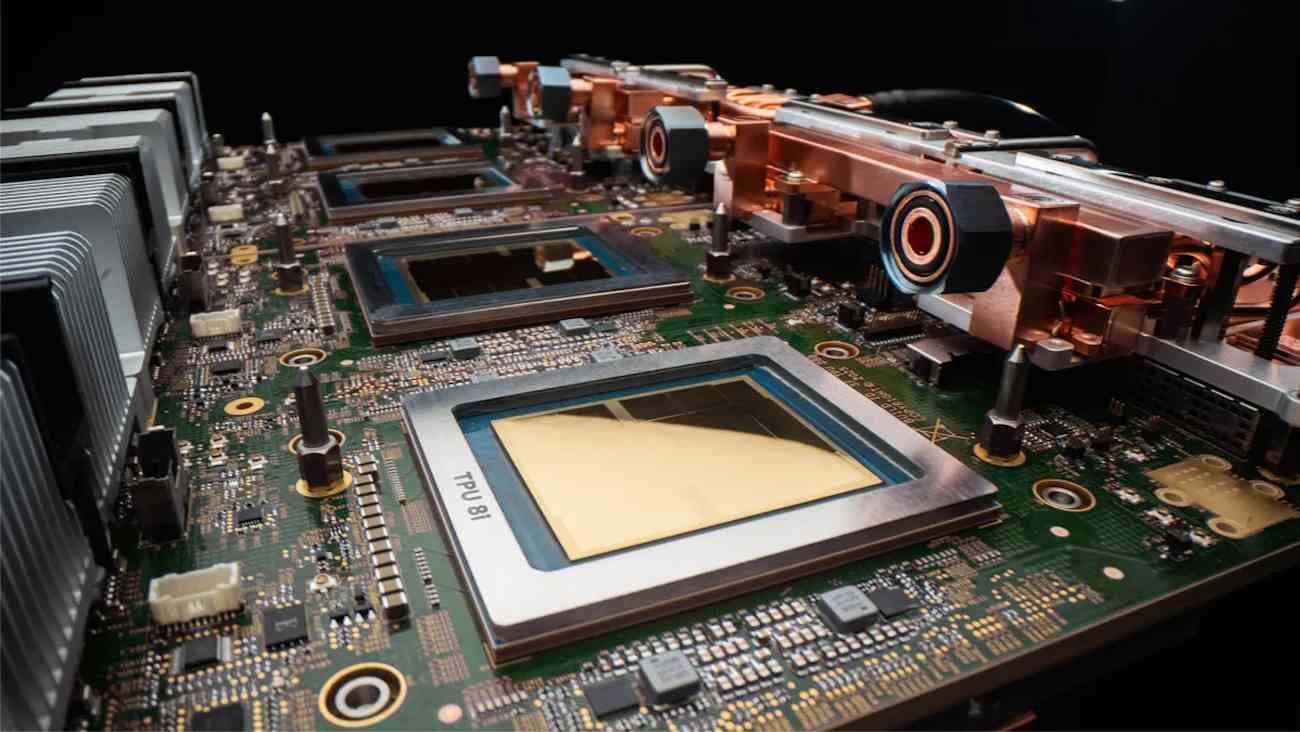

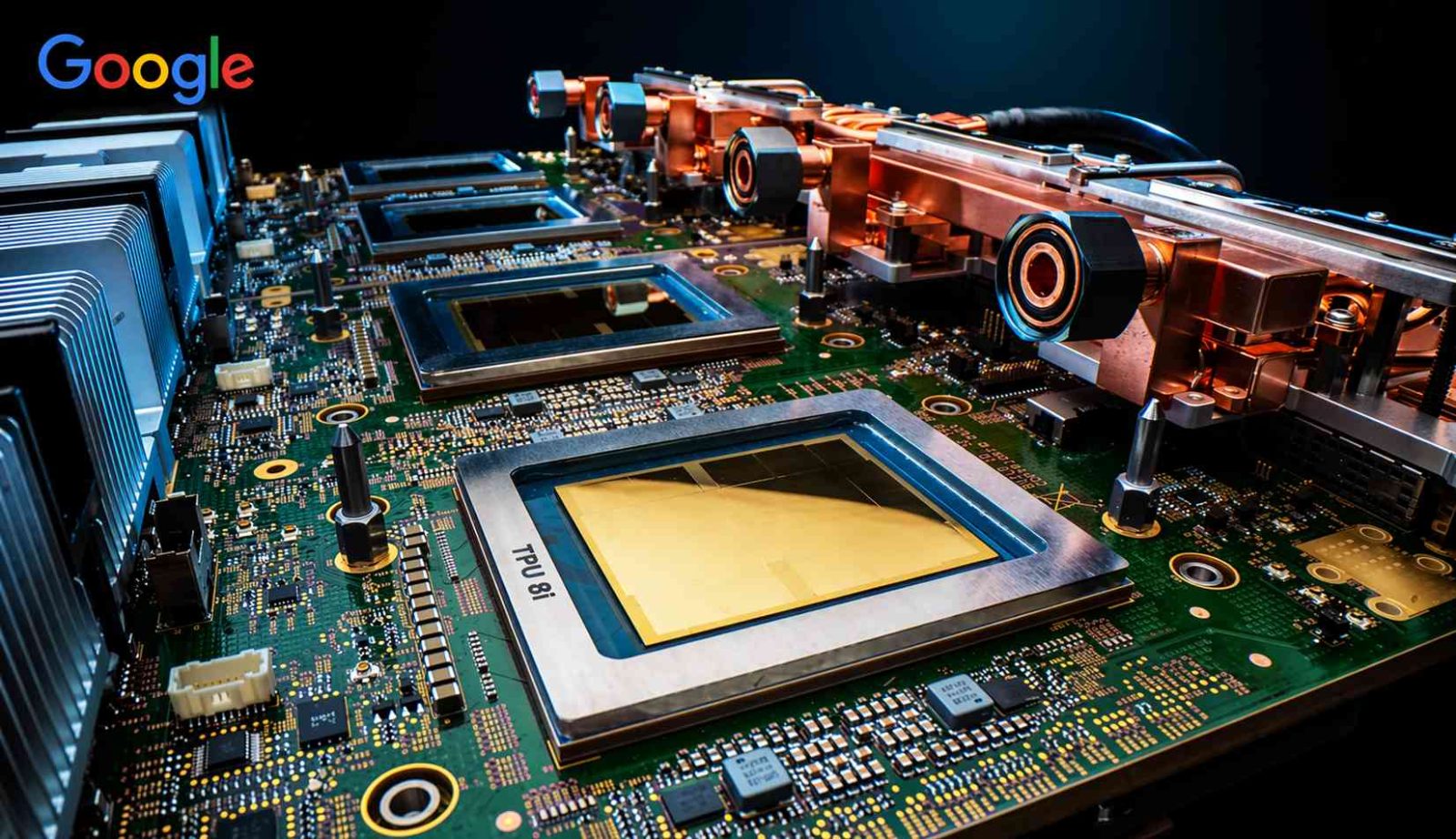

Google acaba de dar un paso importante en la carrera por el hardware de inteligencia artificial. En el evento Cloud Next ’26, la compañía ha presentado dos nuevos chips diseñados específicamente para tareas de IA: el TPU 8t y el TPU 8i. Cada uno con una función distinta y con cifras de rendimiento que merecen atención.

Lo interesante aquí no es solo la potencia bruta, Google ha decidido separar entrenamiento e inferencia en dos chips diferentes, algo que rompe con lo que hace la mayoría del sector. Es una apuesta clara por la especialización, y tiene sentido cuando miras los números que prometen.

Dos chips TPU distintos para dos tareas distintas

El TPU 8t está pensado para entrenar modelos de IA, un solo superpod puede escalar hasta 9.600 chips y cuenta con 2 petabytes de memoria compartida de alto ancho de banda. Son cifras enormes, pensadas para alimentar los modelos más grandes que Google necesita internamente y que ofrece a sus clientes cloud.

Los chips TPU 8i son capaces de ofrecer el rendimiento y la baja latencia necesarios para ejecutar simultáneamente millones de agentes de forma rentable, afirmó Sundar Pichai, CEO de Alphabet.

El TPU 8i, por su parte, se centra en inferencia, aquí es donde se ejecutan las tareas reales de IA una vez que el modelo ya está entrenado. Google asegura que este chip ofrece una latencia casi nula y hasta un 80% más de rendimiento por dólar frente a generaciones anteriores. Para quien gestione cargas masivas de inferencia de IA, la diferencia económica puede ser considerable.

Eficiencia energética como argumento central

Ambos chips superan a Ironwood, su predecesor, en potencia pura, y eso plantea un problema conocido: alimentarlos en los centros de datos. Google lo aborda con un sistema de gestión energética integrado que ajusta el consumo en tiempo real según la demanda. El resultado, según la compañía, es el doble de rendimiento por vatio respecto a Ironwood.

No es un detalle menor, el consumo energético se ha convertido en uno de los grandes cuellos de botella para escalar infraestructura de IA, y cualquier mejora real en este frente tiene un impacto directo en costes operativos.

Google no compite con Nvidia en el mismo terreno

Hay una diferencia clave entre la estrategia de Google y la de Nvidia. Esta última compañía vende sus chips a quien quiera comprarlos. Google, en cambio, reserva sus TPU para clientes de Google Cloud que buscan una alternativa al ecosistema Nvidia. No es un producto que vayas a encontrar en el mercado abierto.

Eso sí, Google no le da la espalda a Nvidia, de hecho, ha confirmado que será una de las primeras empresas en ofrecer los sistemas NVIDIA Vera Rubin NVL72. Es una relación pragmática: compiten en diseño de chips propios, pero colaboran cuando el cliente lo necesita.

Con esta octava generación de TPU, Google refuerza su posición como fabricante de hardware especializado para IA. La separación entre entrenamiento e inferencia puede parecer un detalle técnico, pero para las empresas que mueven cargas pesadas en la nube, elegir el chip adecuado para cada tarea marca la diferencia en coste y rendimiento.

Comentarios!

¡Ver comentarios y opinar!