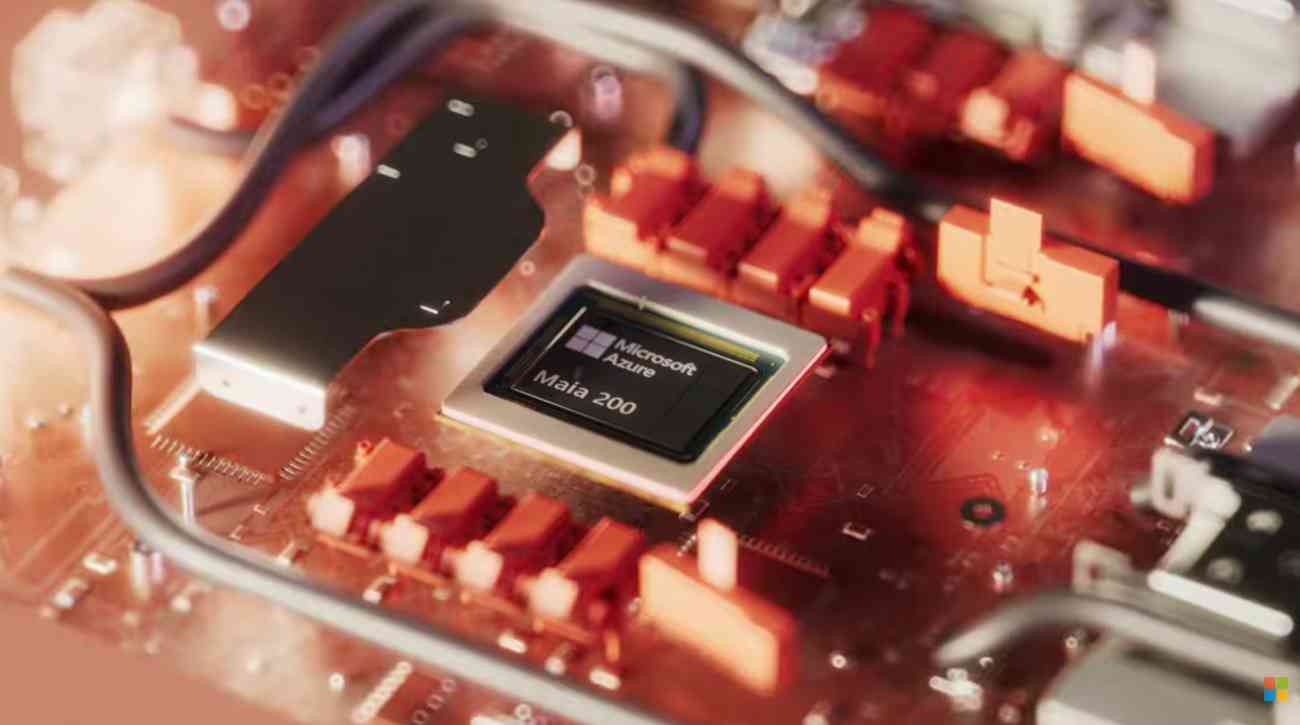

Microsoft ha dado un nuevo paso en el desarrollo de hardware para la IA con el anuncio oficial de Maia 200, su acelerador de IA de segunda generación diseñado para ofrecer un rendimiento superior y una inferencia más rentable. Este nuevo chip llega apenas un año después del debut del Maia 100 y promete marcar un antes y un después en la infraestructura de IA de Azure.

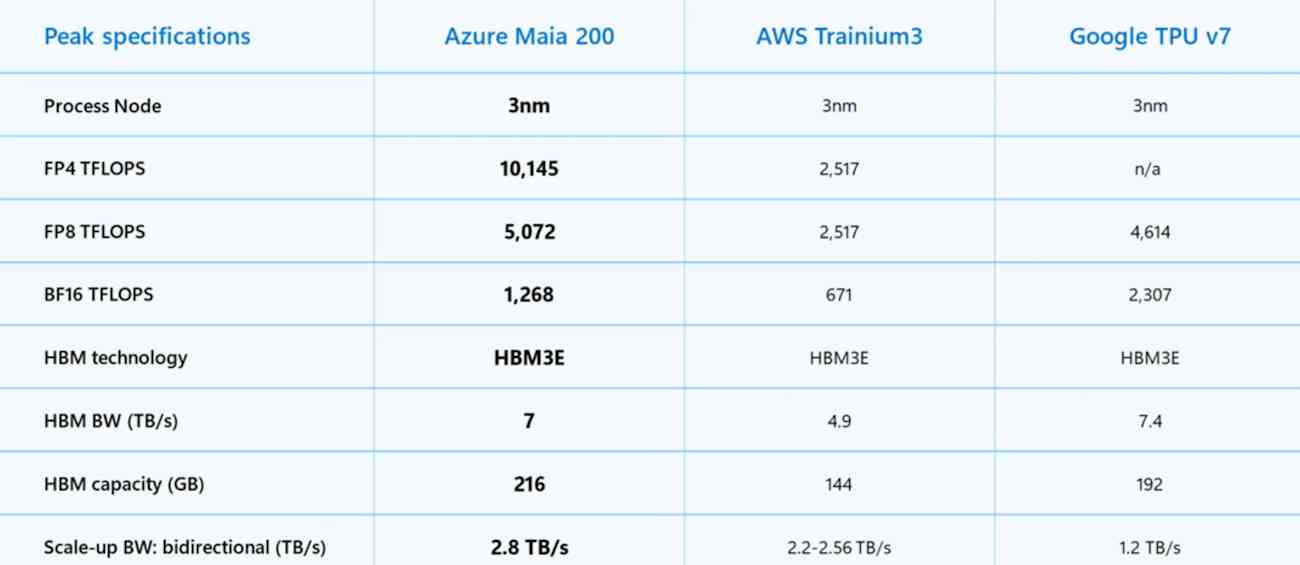

El anuncio confirma que Maia 200 se construye sobre el proceso de 3 nm de TSMC, incorporando núcleos tensoriales FP8 y FP4 nativos, una arquitectura pensada para maximizar la eficiencia energética y el rendimiento por dólar. Además, cuenta con 216 GB de memoria HBM3e y un impresionante ancho de banda de 7 TB/s, acompañado de 272 MB de SRAM en chip.

Maia 200 y la apuesta de Microsoft por la inferencia escalable

De acuerdo a la publicación oficial de Microsoft, este nuevo chip es el silicio interno de mayor rendimiento desarrollado por un hiperescalador, superando incluso las soluciones de Amazon y Google. En las pruebas comparativas, el Maia 200 mostro el doble de rendimiento FP8 que el Trainium v3 de Amazon y un 10 % más que el TPU v7 de Google, posicionándolo como una referencia en el mercado de aceleradores de IA.

Maia 200 representa el siguiente paso en nuestro compromiso de construir una infraestructura de IA de clase mundial, optimizada para inferencia y entrenamiento a gran escala, destacó Microsoft en su comunicado oficial.

Pero más allá del rendimiento obtenido, por supuesto que la eficiencia también es clave. Los Redmond han asegurado que el Maia 200 ofrece un 30 % más de rendimiento por dólar frente al hardware actual de Azure, reforzando su estrategia de ofrecer servicios de IA más sostenibles y accesibles.

Integración con Azure y los modelos de OpenAI

Sin embargo, una de las grandes ventajas del chips Maia 200 es su integración directa con el ecosistema de Microsoft. El chip ya está implementado en los centros de datos de US Central (Iowa) y US West 3 (Arizona), impulsando tanto los servicios de Microsoft 365 como los modelos avanzados de OpenAI, incluyendo GPT-5.2.

Este despliegue también beneficiará al equipo de Superinteligencia de Microsoft, que utilizará Maia 200 para la generación de datos sintéticos y proyectos de aprendizaje por refuerzo, claves en la creación de los futuros modelos internos de la compañía.

Un SDK para desarrolladores y startups

Junto con el lanzamiento, Microsoft presentó el SDK preliminar de Maia, una herramienta que facilitará la optimización de modelos y herramientas de IA para este nuevo chip. El paquete incluye integración con PyTorch, un compilador Triton, bibliotecas de kernel optimizadas y un lenguaje de bajo nivel propio.

Esta apertura busca atraer a startups, investigadores y desarrolladores que quieran aprovechar el poder de Maia 200 sin depender de hardware externo, consolidando el papel de Azure como plataforma de referencia para proyectos de IA a gran escala.

Comentarios!